KI-Prompt-Engineering für Einsteiger: Ab heute bessere Ergebnisse erzielen

5 praktische Prompt-Engineering-Techniken für ChatGPT, Claude und Gemini. Keine Vorkenntnisse nötig – einfach bessere Ergebnisse mit den KI-Tools, die du bereits nutzt.

KI-Prompt-Engineering für Einsteiger

Kurzfassung

Was du wissen musst: Der Unterschied zwischen einer mittelmäßigen und einer wirklich guten KI-Antwort liegt fast immer am Prompt. Präzise, kontextreiche Prompts liefern konsequent bessere Ergebnisse als vage Anfragen – und die Techniken dafür lassen sich in etwa einer Stunde erlernen.

Die wichtigsten Erkenntnisse:

- Rolle + Ziel + Ausgabeformat in einem einzigen Prompt ist die wirkungsvollste Technik für Einsteiger

- Chain-of-Thought-Prompting ("Denke Schritt für Schritt") verbessert die KI-Reasoning-Qualität bei komplexen Aufgaben erheblich

- Few-Shot-Beispiele – der KI 1-2 Beispielausgaben vorab zeigen – ist der schnellste Weg zu konsistenten, stilgerechten Ergebnissen

- Explizite Formatierungsanweisungen (Wortanzahl, Aufzählungspunkte, Tabellen) reduzieren den Nachbearbeitungsaufwand deutlich

- Alle fünf Techniken funktionieren mit ChatGPT, Claude, Gemini und allen anderen gängigen LLMs

Du nutzt bereits KI. Aber die Ergebnisse sind uneinheitlich. Manchmal schreibt sie genau das, was du gebraucht hättest. Ein anderes Mal ist die Antwort generisch, zu lang oder verfehlt den Punkt vollständig.

Die KI ist nicht kaputt. Der Prompt ist es.

Prompt-Engineering klingt technisch. Im Grunde geht es nur darum, klar zu kommunizieren, was du möchtest. Fünf Techniken decken 90 % aller Fälle ab – und du kannst sie alle noch heute anwenden.

Was einen schlechten Prompt ausmacht

Die meisten Menschen schreiben KI-Prompts so, wie sie eine Google-Suche eintippen: kurz, vage, ohne Kontext.

„Schreib eine E-Mail zu unserem Produktlaunch."

Die KI kennt weder dein Produkt, noch deine Zielgruppe, deinen Ton oder das Ziel der E-Mail. Ohne diesen Kontext rät sie – und dieser Rateversuch ist immer die generischste, sicherste Version der Anfrage.

Die KI kann nur mit dem arbeiten, was du ihr gibst. Gib ihr mehr, bekomm mehr zurück.

Technik 1: Die Grundformel (Rolle + Ziel + Format)

Diese eine Änderung verbessert die meisten deiner Prompts sofort.

Statt der KI nur zu sagen, was sie tun soll, nenne ihr drei Dinge:

- Wer sie ist (Rolle)

- Was du möchtest (Ziel + Kontext)

- Wie du es möchtest (Ausgabeformat)

Vorher:

Schreib eine E-Mail zu unserem Produktlaunch.Nachher:

You are a product marketer at a B2B SaaS company. Write a 3-paragraph email

to existing customers announcing a new analytics feature. Tone: professional

but not stiff. End with a CTA to book a 15-minute demo call.Der zweite Prompt gibt der KI eine klare Perspektive. Das Ergebnis ist deutlich nützlicher und braucht kaum noch Nachbearbeitung.

Technik 2: Rollen-Prompting

Einer KI eine bestimmte Rolle zuzuweisen prägt ihr Vokabular, ihre Annahmen und den Detailgrad ihrer Antworten.

„Agiere als erfahrener Softwareingenieur, der diesen Code auf Sicherheitslücken prüft" liefert eine ganz andere Antwort als „prüf diesen Code."

Effektive Rollen-Vorlagen:

- „Du bist ein [Beruf] mit [X] Jahren Erfahrung im Bereich [Fachgebiet]. Deine Zielgruppe ist [Publikum]."

- „Agiere als [spezifischer Experte], der sich auf [Nischenbereich] spezialisiert hat."

- „Du bist ein [Rolle], der für [bestimmtes Publikum] schreibt. Verwende eine Sprache, die zum [Erfahrungslevel] passt."

Die Rolle muss keine echte Berufsbezeichnung sein. „Agiere als äußerst kritischer Lektor, der unnötige Wörter gnadenlos streicht" funktioniert hervorragend, um knappen, präzisen Text zu erhalten.

Ein paar Rollen, die es sich lohnt, parat zu haben:

| Aufgabe | Effektive Rolle |

|---|---|

| E-Mail-Entwürfe | „Produkt-Marketer, der an [Zielgruppe] schreibt" |

| Code-Review | „Erfahrener Ingenieur mit Fokus auf Sicherheit/Performance" |

| Konzepte vereinfachen | „Technischer Autor, der für nicht-technische Leser erklärt" |

| Strategiearbeit | „Unternehmensberater mit [Branchen]-Expertise" |

| Schreib-Feedback | „Strenger, aber konstruktiver Lektor, der Klarheit über alles stellt" |

Technik 3: Chain-of-Thought-Prompting

Bei komplexen Aufgaben solltest du der KI sagen, dass sie das Problem durchdenken soll, bevor sie antwortet. Das nennt sich Chain-of-Thought-Prompting und verbessert die Qualität bei reasoning-intensiven Aufgaben erheblich.

Die einfachste Version: Füge „Denke Schritt für Schritt, bevor du deine abschließende Antwort gibst" zu einem beliebigen Prompt hinzu.

Gute Anwendungsfälle:

- Komplexe Analysen oder strategische Fragestellungen

- Fehlersuche bei Code oder technischen Problemen

- Mathematische und logische Aufgaben

- Entscheidungssituationen mit Abwägungen

Beispiel:

I'm choosing between two CRMs for a 5-person team. We need email integration,

a mobile app, and a pipeline view. Our budget is $50/month. Think through the

trade-offs step by step before making a recommendation.Dadurch zeigt die KI ihr Reasoning. Das Ergebnis wird hilfreicher und die Logik lässt sich leichter nachvollziehen.

Wer Reasoning-Modelle wie OpenAI's o1, o3 oder Claudes Extended-Thinking-Modus nutzt, bekommt das automatisch. Bei Standard-Chat-Modellen macht der Hinweis jedoch einen Unterschied.

Technik 4: Few-Shot-Beispiele

Das ist der schnellste Weg zu konsistenten, stilgerechten Ergebnissen: Zeig der KI genau, was du möchtest, bevor du sie darum bittest.

Gib der KI 1–3 Beispiele für das Format, den Stil oder die Struktur, die du dir vorstellst. Danach folgt deine eigentliche Anfrage.

Vorlage:

Here are examples of the tone I want:

Example 1: [input] → [output]

Example 2: [input] → [output]

Now do the same for: [your actual request]Konkretes Beispiel:

Here are examples of the writing style I want:

Input: Product announcement for a scheduling tool

Output: "Scheduling just got easier. Set your availability once, share a link,

done. No more back-and-forth emails."

Input: Product announcement for a file storage tool

Output: "Your files, wherever you are. Upload from any device, access from all

of them. Simple."

Now write one for: a new AI chat assistant feature in our project management tool.Die KI übernimmt Länge, Rhythmus und Ton aus deinen Beispielen. Zwei Beispiele reichen in der Regel aus.

Technik 5: Ausgabeformat-Anweisungen

Die meisten Einsteiger vergessen anzugeben, wie sie die Ausgabe strukturiert haben möchten. Die KI fällt dann auf das zurück, was sich für sie natürlich anfühlt – was aber nicht immer zum eigenen Bedarf passt.

Sag ihr genau, was du willst:

| Statt... | Besser so... |

|---|---|

| „Schreib eine Zusammenfassung" | „Fasse in 3 Stichpunkten zusammen, jeder unter 15 Wörtern" |

| „Analysiere diese Daten" | „Formatiere als Tabelle: Kennzahl, Wert, Bedeutung" |

| „Nenn mir Vor- und Nachteile" | „Liste 3 Vor- und 3 Nachteile auf. Je ein Satz." |

| „Erkläre dieses Konzept" | „Erkläre es für einen intelligenten, nicht-technischen Leser. Unter 100 Wörtern." |

| „Erstell einen Bericht" | „Verwende Markdown-Überschriften. Beginne jeden Abschnitt mit der wichtigsten Erkenntnis." |

Formatierungsanweisungen machen die Ausgabe nicht nur übersichtlicher. Sie zwingen die KI auch dazu, anders zu priorisieren. „3 Stichpunkte, je unter 15 Wörtern" erzwingt Prägnanz. „Beginne mit der wichtigsten Erkenntnis" erzwingt eine Bottom-Line-up-Front-Struktur.

Alles zusammen: Vorher vs. Nachher

So sieht der vollständige Technik-Stack an einem realen Beispiel aus.

Szenario: Du möchtest einen LinkedIn-Post über eine Karriere-Lektion schreiben.

Einfacher Prompt:

Write a LinkedIn post about a lesson I learned about time management.Ergebnis: Generisch. Hätte von jedem über alles Mögliche geschrieben sein können.

Optimierter Prompt:

You are a senior product manager with 10 years of experience. Write a LinkedIn

post about learning to say no to meetings that don't require your decision-making.

Tone: honest and direct, not preachy. No hashtags. Under 150 words. Start with

a short punchy opening line that hooks the reader. End with one practical tip.Ergebnis: Konkret, gut strukturiert, klingt nach jemandem mit echter Erfahrung.

Der Unterschied liegt nicht in der Komplexität, sondern in der Spezifität. Je konkreter die Vorgaben, desto weniger Spielraum hat die KI, auf Generisches zurückzufallen.

So gehst du vor, wenn die Ergebnisse noch nicht stimmen

Gute Prompts entstehen selten beim ersten Versuch. Betrachte es wie einen Entwurf.

Wenn das erste Ergebnis zu 80 % stimmt, setz das Gespräch fort:

- „Gut. Jetzt mach es 30 % kürzer."

- „Streiche die formelle Sprache – es soll klingen wie ein Kollege, der redet."

- „Der dritte Punkt ist schwach. Schreib nur diesen Abschnitt neu und füge ein konkretes Beispiel ein."

- „Ändere den Ton von überzeugend zu informierend."

Du musst den gesamten Prompt nicht jedes Mal neu schreiben. Bau auf dem auf, was bereits funktioniert.

Das ist besonders nützlich für Schreib- und Content-Aufgaben. Einen tieferen Einblick in KI-Tools speziell für Schreib-Workflows findest du im Artikel best AI for writing in 2026.

Häufige Fehler

Zu vage. „Hilf mir beim Marketing" gegenüber „Schreib drei Betreffzeilen für eine Re-Engagement-E-Mail an Kunden, die seit 90 Tagen nichts gekauft haben." Der zweite Prompt lässt kaum Raum für eine schlechte Antwort.

Zu viele Aufgaben auf einmal. Stopf keine fünf Anfragen in einen Prompt. Teile komplexe Aufgaben in Schritte auf: Bitte zuerst um eine Gliederung, dann um die Ausarbeitung der einzelnen Abschnitte.

Kein Kontext zur Zielgruppe. Die KI weiß nicht, ob du für Zwölfjährige oder Doktoren schreibst. Sag es ihr explizit.

Die erste Antwort akzeptieren. Iteriere. Die meisten guten Ergebnisse entstehen nach 2–3 Austauschen, nicht nach einem einzigen perfekten Prompt.

Erwarten, dass sie Gedanken liest. Wenn du Einschränkungen hast (Wortanzahl, zu vermeidende Themen, bevorzugtes Format), nenn sie von Anfang an. Entdecke sie nicht erst, nachdem du eine Antwort gelesen hast, die du nicht verwenden kannst.

Wenn du solide Prompts für häufige Aufgaben hast, kannst du sie als Bausteine nutzen, um wiederkehrende KI-Workflows zu automatisieren – zum Beispiel mit Tools wie Zapier oder Make.

Funktioniert das bei allen KI-Modellen?

Ja. Die Kerntechniken funktionieren bei ChatGPT, Claude, Gemini und allen anderen gängigen LLMs.

Ein paar kleinere Unterschiede, die es wert sind, bekannt zu sein:

ChatGPT (GPT-4o): Reagiert gut auf strukturierte Prompts mit klaren Abschnitten. Verarbeitet Prompts mit mehreren Vorgaben sauber. Schnell bei den meisten Aufgaben.

Claude (Anthropic): Besonders gut darin, detaillierte und nuancierte Anweisungen zu befolgen. Handhabt langen Kontext und subtile Tonanforderungen besser als die meisten Modelle. Wenn du konkret über Stimme und Stil bist, liefert Claude in der Regel überzeugende Ergebnisse.

Gemini (Google): Stark bei Aufgaben, die von Zugang zu aktuellen Informationen profitieren. Dieselben Prompting-Techniken gelten; der Ausgabestil unterscheidet sich leicht.

Die Techniken auf dieser Seite funktionieren mit allen. Nimm das Modell, das du bereits nutzt, und wende sie dort an.

Wenn du noch unentschlossen bist, welche KI du verwenden möchtest, deckt der ChatGPT vs. Claude Vergleich die praktischen Unterschiede für gängige Anwendungsfälle ab.

Häufig gestellte Fragen

Was ist der Unterschied zwischen Prompt-Engineering und dem normalen „Nutzen von KI"?

Prompt-Engineering ist die bewusste Praxis, Prompts so zu gestalten, dass sie spezifische, hochwertige Ergebnisse liefern. Die meisten Menschen „nutzen KI", indem sie spontane Anfragen eintippen und akzeptieren, was zurückkommt. Prompt-Engineering bedeutet, absichtsvoll vorzugehen – bei dem, was man fragt, und bei der Art, wie man es formuliert. Der Unterschied zwischen beiden Ansätzen ist oft ein 5-facher Qualitätsunterschied in der Ausgabe.

Wie lang sollte ein Prompt sein?

Lang genug, um Rolle, Ziel, Kontext und Formatierungsanweisungen zu enthalten – und kurz genug, um klar zu bleiben. Für die meisten Aufgaben sind 50–150 Wörter die ideale Länge. Komplexe technische Aufgaben können länger sein. Einfache Formatierungs- oder Zusammenfassungsanfragen können aus einem einzigen Satz bestehen. Wenn dein Prompt länger als ein Absatz ist und trotzdem noch vage wirkt, brauchst du mehr Spezifität, nicht mehr Worte.

Muss ich diese Techniken auswendig lernen?

Nein. Die meisten Menschen verinnerlichen 2–3 Techniken nach einer Woche bewusster Übung. Fang mit der Grundformel an (Rolle + Ziel + Format), da sie jeden Prompt sofort verbessert. Füge die anderen hinzu, wenn du auf eine Aufgabe stößt, bei der sie hilfreich wären.

Was, wenn ich all diese Tipps befolge, aber immer noch schlechte Ergebnisse bekomme?

Probiere ein anderes Modell – manche Aufgaben passen schlicht besser zu bestimmten Modellen. Überprüfe außerdem, ob Rolle und Kontext tatsächlich präzise und in sich konsistent sind. Wenn du der KI sagst, „wie ein Experte zu schreiben", ihr aber lässige Beispiele gibst, bekommt sie widersprüchliche Signale. Und iteriere: Betrachte die erste Antwort als Ausgangspunkt, nicht als fertiges Produkt.

Lohnt es sich, das zu lernen, wenn KI-Tools sich ständig verbessern?

Ja. Bessere Modelle reagieren immer noch besser auf gut strukturierte Prompts. Der Abstand zwischen einem guten und einem vagen Prompt hat sich mit verbesserten Modellen nicht verringert – wenn überhaupt, haben leistungsfähigere Modelle mehr Potenzial, bei klarer Anleitung bessere Dinge zu tun. Die Grundlagen, die du heute lernst, werden auf jedes Modell anwendbar sein, das danach kommt.

Fazit

Die meisten Menschen holen nur einen Bruchteil dessen aus KI heraus, was möglich wäre – weil sie ihre Art zu fragen nicht verändert haben. Füge eine Rolle hinzu, gib das Ausgabeformat vor, gib der KI ein konkretes Ziel – die Ergebnisse verbessern sich sofort.

Die fünf Techniken sind:

- Rolle + Ziel + Format in einem Prompt

- Eine passende, spezifische Rolle zuweisen

- Bei komplexem Reasoning Schritt für Schritt denken lassen

- Beispiele geben, wenn du konsistenten Stil oder Struktur möchtest

- Genau angeben, wie die Ausgabe formatiert sein soll

Fang mit der ersten Technik an. Die Grundformel allein wird bei jeder Aufgabe, für die du regelmäßig KI nutzt, einen spürbaren Unterschied machen.

Wer diese Techniken über mehrere KI-Modelle hinweg anwenden möchte, ohne ständig zwischen Tabs zu wechseln: Zemith bietet Zugang zu ChatGPT, Claude und anderen in einer einzigen Oberfläche.

Zemith Funktionen entdecken

Jede Top-KI. Ein Abo.

ChatGPT, Claude, Gemini, DeepSeek, Grok & 25+ mehr

Immer aktiv, Echtzeit-KI.

Sprache + Bildschirmfreigabe · sofortige Antworten

Wie lernt man am besten eine neue Sprache?

Immersion und verteilte Wiederholung funktionieren am besten. Versuchen Sie, täglich Medien in Ihrer Zielsprache zu konsumieren.

Sprache + Bildschirmfreigabe · KI antwortet in Echtzeit

Bildgenerierung

Flux, Nano Banana, Ideogram, Recraft + mehr

Schreibe in Gedankengeschwindigkeit.

KI-Autovervollständigung, Umschreiben & Erweitern auf Befehl

Jedes Dokument. Jedes Format.

PDF, URL oder YouTube → Chat, Quiz, Podcast & mehr

Videoerstellung

Veo, Kling, MiniMax, Sora + mehr

Text-zu-Sprache

Natürliche KI-Stimmen, 30+ Sprachen

Code-Generierung

Schreiben, debuggen & Code erklären

Chat mit Dokumenten

PDFs hochladen, Inhalte analysieren

Deine KI in der Tasche.

Voller Zugang auf iOS & Android · überall synchronisiert

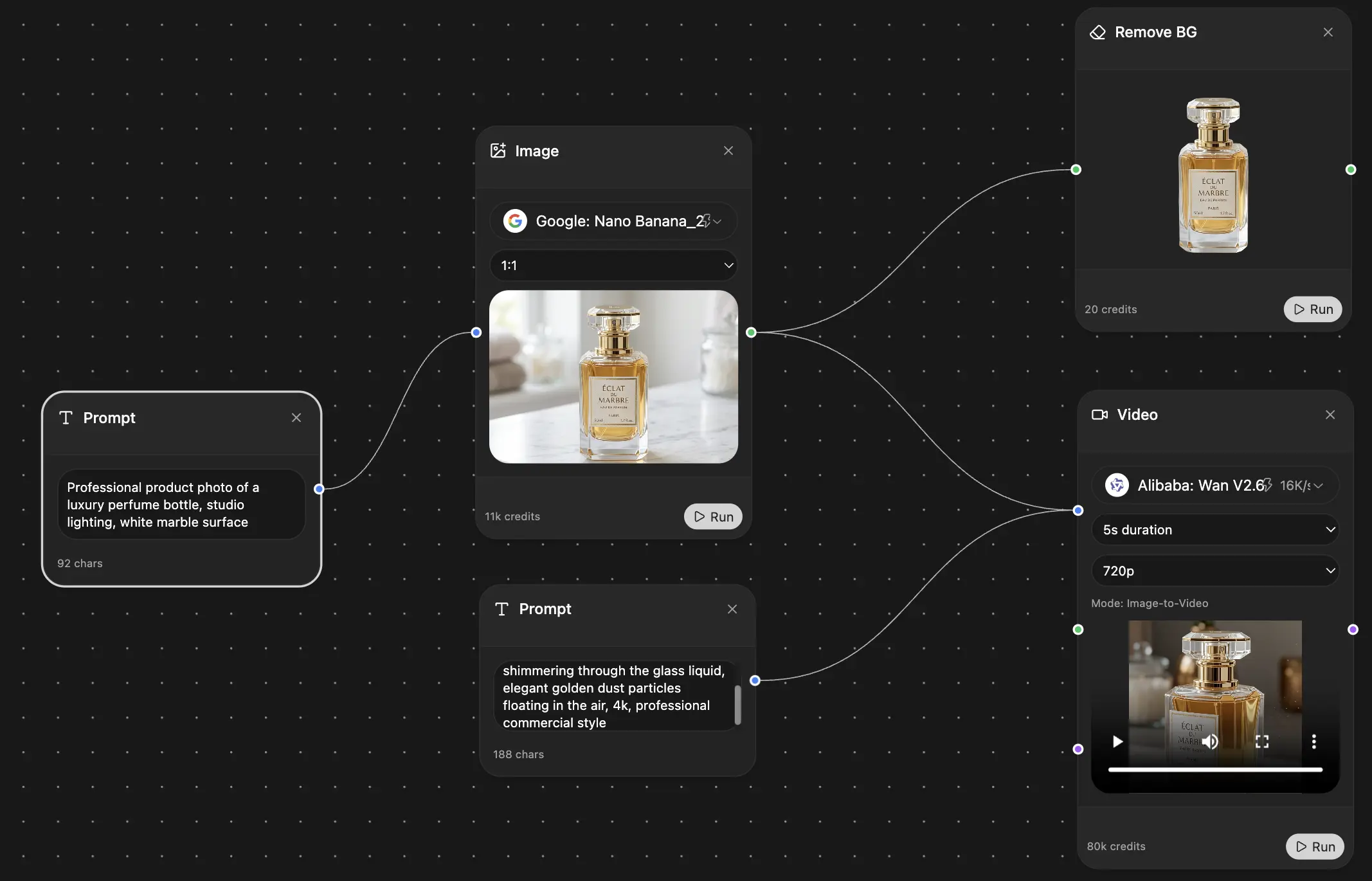

Deine unendliche KI-Leinwand.

Chat, Bild, Video & Motion-Tools — nebeneinander

Sparen Sie Stunden an Arbeit und Forschung

Einfache, erschwingliche Preise

Vertraut von Teams bei

Kostenlos

Keine Kreditkarte erforderlich

- 100 Credits täglich

- 3 KI-Modelle zum Ausprobieren

- Einfacher KI-Chat

Plus

- 1.000.000 Credits/Monat

- 25+ KI-Modelle — GPT, Claude, Gemini, Grok & mehr

- Agent Mode mit Websuche, Computer-Tools und mehr

- Creative Studio: Bildgenerierung und Videogenerierung

- Project Library: Chat mit Dokumenten, Webseiten und YouTube, Podcast-Erstellung, Lernkarten, Berichte und mehr

- Workflow Studio und FocusOS

Professional

- Alles in Plus, plus:

- 2.100.000 Credits/Monat

- Pro-exklusive Modelle (Claude Opus, Grok 4, Sonar Pro)

- Motion Tools & Max Mode

- Erster Zugang zu den neuesten Funktionen

- Zugang zu zusätzlichen Angeboten