AI认知过载是真实存在的:为什么用越多AI工具反而越低效

BCG对1,488名员工的研究发现,使用4个以上AI工具会导致生产力下降。以下是2026年数据对AI工具过载的解读,以及你究竟需要多少工具。

AI认知过载是真实存在的:为什么用越多AI工具反而越低效

摘要

你需要知道的是: 当AI工具数量超过某个临界点后,继续添加工具反而会主动损害你的产出。BCG对1,488名员工的研究发现,生产力在使用1到3个AI工具时达到峰值,此后随着工具数量增至4个或以上而下降。

核心发现:

- BCG(2026年3月):使用4个以上AI工具会触发"AI认知过载"——即因管理的工具数量超出有效监管能力而产生的心理疲劳

- 高监管程度的AI使用会带来14%更高的心理投入、12%更大的心理疲劳感、19%更严重的信息过载

- 高盛发现AI采用率与全经济范围内的生产力之间"没有显著关联"

- AI生产力提升约30%仅出现在范围明确的特定任务中:客服支持和软件开发

- 软件开发者预测AI能为他们节省24%的时间——而一项对照研究发现,AI实际上让他们慢了19%

- 解决之道在于整合,而非扩张:深度使用少数工具的效果,远优于浅度使用多数工具

你大概对这种感觉并不陌生。你从ChatGPT开始,然后因为有人说Claude更擅长写作就加了它,接着为了做研究用上了Perplexity,又加了一个会议AI记录工具,再加了一个专用编程助手。现在你有六个AI订阅,却莫名地比以前更忙了。

BCG为这种现象起了个名字:AI认知过载。

2026年3月,BCG在《哈佛商业评论》上发表了一项针对1,488名美国全职员工的研究。其中最受关注的发现并非AI没有用,而是使用过多AI会让你的工作表现变差。

什么是AI认知过载?

BCG将其定义为"因过度使用或监管AI工具、超出自身认知承载能力而产生的心理疲劳"。

参与者用这些词来描述这种感受:"嗡嗡作响"的感觉、思维迷雾、难以集中注意力、决策变慢。一位高级工程总监说得很直白:"我花在管理工具上的精力,比真正解决问题的精力还要多。"

这句话道出了陷阱的本质。你添加AI工具是为了减轻认知负担,但每个工具都会产生自己的额外成本:编写提示词、评估输出结果、检查错误、切换上下文。到了某个节点,这些额外成本会超过工具本身节省的时间。

BCG的数据清楚地显示了这个临界点在哪里。生产力在员工从使用1个工具增至2个时提升,在3个时继续上升,到了4个或以上则开始下降。

营销岗位的员工受影响最大——26%的人报告出现了AI认知过载的症状。工程、财务、人力资源和IT领域也有显著比例。法律领域最低,仅为6%。

过载背后的数字

当AI任务需要高度人工监管时,BCG测量到了具体的认知成本:

- 比非AI任务多14%的心理投入

- 12%更大的心理疲劳

- 19%更严重的信息过载

这些额外负担并非来自工作本身,而是来自对AI的监管。你仍然需要阅读每一份输出结果、检查是否有幻觉内容、决定保留什么、修改错误之处。这是一项以前不存在的新工作,而当你同时在多个工具之间执行这项工作时,负担会成倍叠加。

这与我们对认知负荷理论的认知是一致的。你的工作记忆容量是有限的,每增加一个工具都会带来上下文切换成本和评估负担。当这些成本不断堆积,你的产出质量就会下降,即便工具数量在增加。

高盛:更宏观的视角

BCG的发现并非孤例。2026年3月初,高盛也发布了一份令人不安的结论:"我们仍未发现生产力与AI采用率之间在全经济层面存在显著关联。"

考虑到过去三年间企业在AI工具上的巨额投入,这个表述着实令人震惊。

高盛确实发现了生产力提升——但仅限于两种特定情境:客服支持和软件开发任务。在这些范围明确的应用场景中,生产力提升的中位数约为30%。关键词是"范围明确":有清晰成功标准、可量化产出、对监管要求有限的任务。而非那些你需要持续判断质量的开放式知识工作。

至于实际上有多少公司在衡量这些数据:标普500企业中只有10%量化了AI对特定用例的影响,只有1%量化了其对收益的影响。与此同时,70%的公司在季度财报电话会议上都提到了AI。

大多数公司都在谈论AI生产力,但没有真正衡量它。

打破叙事的开发者实验

2025年的METR研究是这一议题上最具体的数据点。METR研究人员雇用了16名经验丰富的开源开发者,使用Cursor Pro配合Claude 3.5/3.7 Sonnet完成246项任务——这是当时最优秀的AI编程组合之一。

研究开始前,开发者们预测AI会让他们的效率提高24%。

实际结果:他们慢了19%。

这一发现尤为引人注目的是研究结束后的问卷调查。即使在完成了所有任务、亲身经历了效率下降之后,这些开发者仍然认为AI让他们变快了。他们入组时预测会快24%,在被测量证明实际更慢之后,他们估计自己快了20%。

这不仅是生产力差距,更是认知差距。当你使用AI感觉很高效——当产出感觉来得更快,当你在生成更多内容,当工作感觉在向前推进时——很容易将这种感受误认为真正的效率提升。

有时候,生产力的感觉与实际的生产力,指向的是完全相反的方向。

为什么工具越堆越多感觉像是在进步

即使回报在递减,AI工具栈仍会不断增长,这背后有心理学原因。

每一个新工具在单独看来都解决了一个真实问题。AI会议记录工具确实比你自己记录得更好。专用研究工具确实比手动搜索更快找到来源。编程助手确实比手动输入更快补全样板代码。

问题不在于任何一个单独的工具,而在于它们共同构成的系统。

当你有六个工具时,你也有六个界面需要学习、六种不同的提示风格需要掌握、六份输出结果需要同时评估、六个订阅费需要证明其价值。认知负担变成了无处不在的背景噪音。你不只是在工作——你在管理你的AI工具栈。

这也是为什么免费与付费AI工具的问题比表面看起来更复杂。这不仅仅是成本问题。每增加一个付费工具,就意味着新增一套决策:何时使用它、是否信任它的输出、如何将其结果与其他工具的产出整合。

真正有效的方法

BCG研究和高盛数据指向同一个底层原则:对AI的专注深度使用,优于宽泛浅层的使用。

数据中呈现出以下几种有效模式:

明确分配具体任务。 将边界清晰、定义明确的任务分配给AI(总结这份内容、起草一份回复、为这个论点找引用)的员工,比那些试图在整个工作流程中将AI作为通用思考伙伴的员工表现更好。任务定义得越具体,所需的监管就越少。

一个工作流程只用一个工具。 与其在同一个项目中来回切换三个AI工具,不如选定一个深度使用,从而减少上下文切换的成本。你会更了解它的优势和缺陷,也会形成何时信任它的判断力。

在关键节点而非全程进行人工审查。 在决策节点审查AI输出,而非在任务执行过程中持续监控,可以减少认知监管的负担。让它先跑,再去评估,不需要全程盯着它看。

这与用AI自动化日常任务真正奏效的逻辑直接相关:需要持续人工干预的自动化,根本算不上自动化,不过是把任务外包给了一个比你稍快、却需要人照看的工具。

整合的理由

如果BCG的结论是正确的,生产力曲线的峰值在1到3个工具,那么大多数知识工作者已经超过了最优点。

这一结论的实际意义不是"停止使用AI",而是:认真想清楚哪2到3个工具值得在你的工具栈中占据永久席位,然后毫不留情地砍掉其余的。

值得用来评估的标准:

- 这个工具减少了监管需求,还是增加了监管需求?

- 我能定义出一组这个工具比其他任何工具都处理得更好的具体任务吗?

- 它的输出质量值得我付出相应的评估成本吗?

- 我用这个工具是因为它真的有帮助,还是因为我不想错过什么?

最后这个问题很重要。FOMO(错失恐惧)是AI工具采用的真实驱动力,但它与生产力并不相关。

对于独立创业者和个体工作者而言,这一点尤为关键。你没有团队来分担管理复杂AI工具栈的额外负担。你添加的每一个工具,都是一件只有你才能评估和维护的事。

常见问题

AI认知过载是永久性的吗?

不是。BCG将其描述为情境性疲劳,而非慢性损伤。减少AI工具数量或转向低监管AI任务的员工都得到了恢复。认知负荷模型表明,当你减少工作记忆的需求时,这种影响是可逆的。

哪些职业风险最高?

营销岗位(26%的员工报告出现症状),其次是人员运营、运营、工程、财务和IT。需要持续判断、质量评估和决策的工作,比结构化、重复性任务产生更多的监管需求。

这意味着AI工具没用吗?

并非如此。高盛在客服支持和软件开发领域发现了真实的30%生产力提升。BCG在1到3个工具的范围内也发现了提升。问题在于规模和监管——当任务边界清晰、输出易于评估时,AI表现良好;当任务是开放性的、质量需要专业判断时,AI则力不从心。

我应该使用多少个AI工具?

BCG的数据表明,对大多数员工而言,1到3个是高效区间。超过这个数量,你花在管理工具上的认知能量很可能已经超过了你节省的时间。合适的数量取决于你的用例边界有多清晰,以及每个工具需要多少监管投入。

METR开发者研究的结论是决定性的吗?

研究人员对此相当谨慎。该研究覆盖的是2025年初的AI能力,针对特定类型的开源开发任务。不同的任务类型或更新的模型可能会有不同的结果。这是一个有力的数据点,而非普适定律。

结语

2026年初最违反直觉的发现是:从AI中获益最多的人,不是使用AI工具最多的人,而是那些找准了AI能可靠完成哪2到3类任务、并围绕这些任务构建工作流程的人——而不是试图将一切都AI化。

AI认知过载是真实的、可测量的,而它的成因,正是驱动大多数软件采用的那种本能:当某样东西有用,就加更多。这个逻辑有效,直到它失效为止。

数据现在已经给出了临界点。我们大多数人都已经越过了它。

如果你希望有一个AI平台能在一个地方处理研究、写作和分析,而无需让你同时应付多个订阅,Zemith 正是围绕这种整合模式构建的。

探索 Zemith 功能

所有顶级AI。一个订阅。

ChatGPT、Claude、Gemini、DeepSeek、Grok 及25+模型

始终在线,实时AI。

语音 + 屏幕共享 · 即时回答

学习一门新语言的最佳方式是什么?

沉浸式学习和间隔重复效果最好。尝试每天消费目标语言的媒体内容。

语音 + 屏幕共享 · AI 实时回答

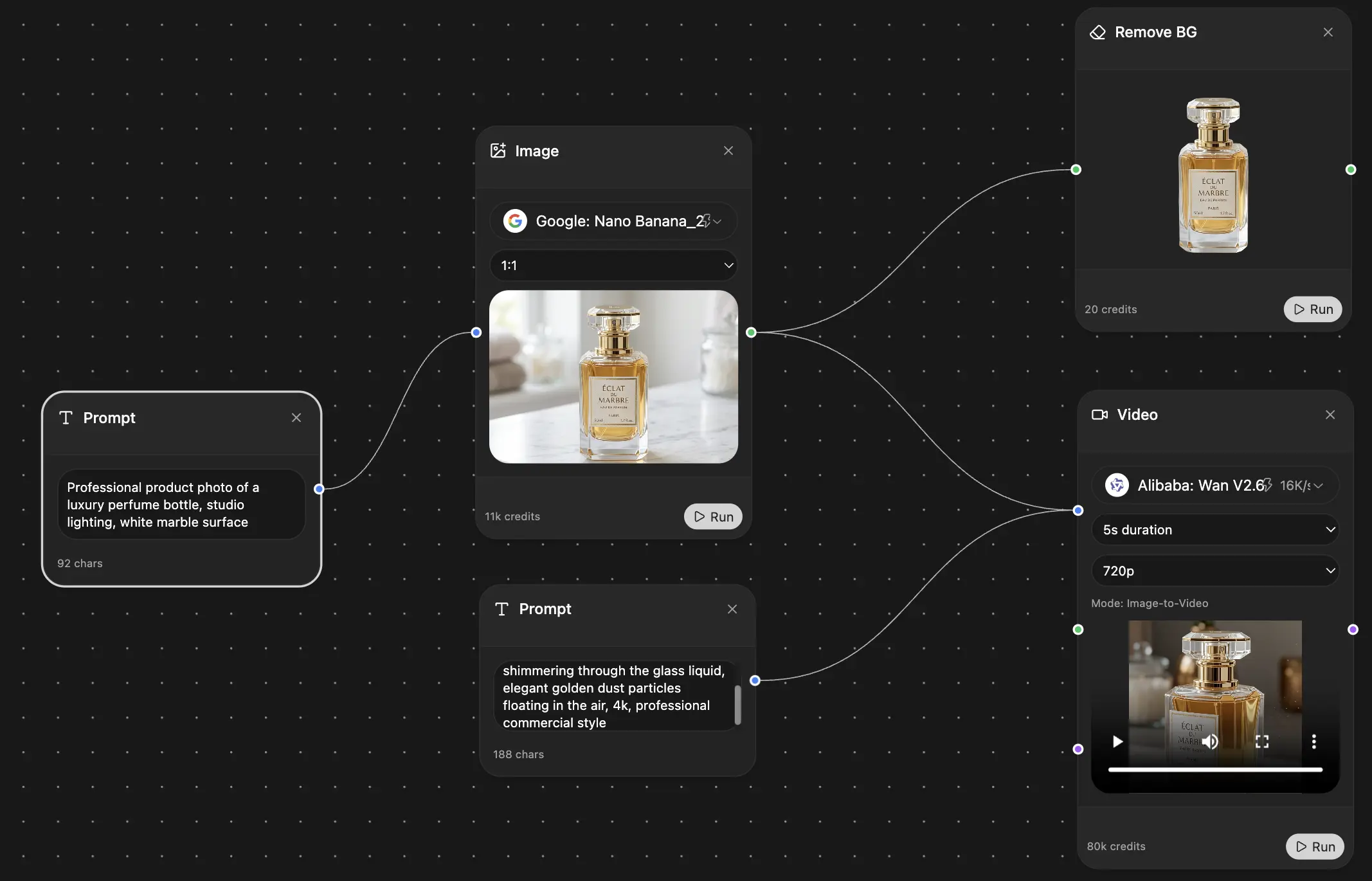

图像生成

Flux、Nano Banana、Ideogram、Recraft + 更多

以思维的速度书写。

AI自动补全、改写和按命令扩展

任何文档。任何格式。

PDF、URL或YouTube → 聊天、测验、播客等

视频创作

Veo、Kling、MiniMax、Sora + 更多

文字转语音

自然AI语音,30+语言

代码生成

编写、调试和解释代码

与文档对话

上传PDF,分析内容

口袋里的AI。

iOS和Android完整访问 · 随处同步

你的无限AI画布。

聊天、图像、视频和动态工具 — 并排展示

节省数小时的工作和研究时间

简单、经济实惠的定价

受信赖的企业团队

免费

无需信用卡

- 每日100积分

- 3个AI模型试用

- 基础AI聊天

增强版

- 1,000,000积分/月

- 25+个AI模型 — GPT、Claude、Gemini、Grok等

- Agent Mode:网页搜索、计算机工具等

- Creative Studio:图像生成和视频生成

- Project Library:与文档、网站和YouTube对话,播客生成、闪卡、报告等

- Workflow Studio和FocusOS

专业版

- 包含增强版所有功能,以及:

- 2,100,000积分/月

- Pro专属模型(Claude Opus、Grok 4、Sonar Pro)

- Motion Tools和Max Mode

- 优先使用最新功能

- 访问额外优惠